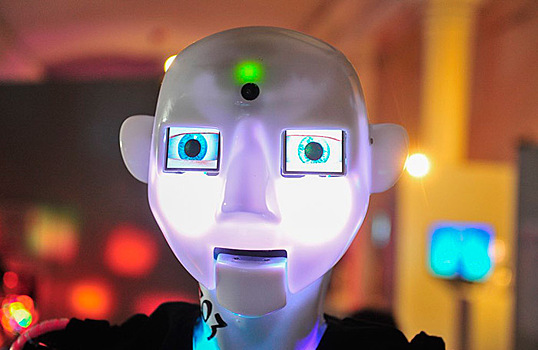

Роботы не понимают любовь

В последние годы алгоритмы, машинный интеллект и прочие IT-решения достигают успехов на таком количестве направлений, что впору впадать в депрессию от того, что людей скоро спишут в утиль, за ненадобностью. Но вот, наконец, нашлась сфера, где роботы бессильны — по крайней мере, по мнению Psychology Today. Например, в материале журнала описан эксперимент группы ученых из трех университетов в США, которые в 2017 году попытались с помощью машинного обучения предсказать, кто кому понравится на нескольких встречах в формате speed dating. Даже при том, что компьютеру скормили тематические опросники из 100 пунктов по каждому участнику, прогнозы машины оказались ошибочными — не распознала она пресловутую «искру». О причинах эмоциональной слепоты алгоритмов рассуждает психолог Анетта Орлова. Анетта Орлова психолог«Ключевыми компетенциями будущего будут критическое мышление и эмоциональный интеллект. Вот робот великолепно владеет критическим мышлением. Что касается эмоционального интеллекта, тут ситуация гораздо сложнее. Безусловно, какие-то моменты можно предугадать, но при этом произойдет этот механизм, волшебство, или не произойдет, 100% предсказать невозможно, потому что у каждого человека есть большое количество собственных разных состояний. В разные моменты, в разных состояниях человек очень по-разному реагирует на противоположный пол, на объект возможной потенциальной влюбленности. Другой разговор, что машина может, грубо говоря, на 80% отсечь то, что точно не подойдет». Проблема в том, что даже это не совсем правда — и винить тут нужно не столько машину. В 2014 году другие американские ученые спросили респондентов, какие качества для них являются deal-breaker, неприемлемыми в партнере — многие назвали политические или религиозные взгляды, курение и склонность к измене. Но когда потом участникам эксперимента сказали, что человек с тремя из заявленных deal-breaker заинтересовался ими и хочет обменяться контактами, на это согласились 74% респондентов. В другом эксперименте 2011 года группу людей отправили на мини-свидания с подставным лицом, который или которая общалась с каждым одинаковыми стандартизованными фразами. Как выяснилось, степень заинтересованности собеседником никак не зависела от заявленных изначально предпочтений, хотя они у всех были разные. Получается, что даже сами люди не способны предсказывать, кто им понравится. Что тогда требовать от роботов? Но пользу они принести могут, считает исполнительный директор сети сервисов знакомств Mamba Ярослав Сергеев. Ярослав Сергеев исполнительный директор сети сервисов знакомств Mamba «Есть алгоритм предиктивного анализа, эти алгоритмы учатся постепенно на выдаче. Т.е. сначала ты с низкой точностью выдаешь пользователю, например, просто всех девушек его возраста где-то неподалеку от него. Потом пользователь голосует, и ты понимаешь, что ему, например, из всех девушек больше нравятся блондинки, значит ему надо с большей вероятностью блондинок показывать. Все количественным решается, т.е. если у человека есть один шанс нажать на кнопку «найдите мне идеальную пару» и вот алгоритм ему должен именно вот одного человека со 100-процентной вероятностью выбрать, то, конечно же, так это не работает. Но ты можешь ему показать 100 человек, с которыми с большей вероятностью совпадет. И как-то самостоятельно отфильтровав этих 100 человек, конечно, он может найти пару». Заканчивает Psychology Today на высокой ноте. Во-первых, в отношениях человек начинает больше ценить те качества, которые есть у партнера, и занижать значение тех, которые отсутствуют. Во-вторых, людям свойственно идеализировать своих спутников и присваивать им достоинства, которых даже они сами в себе не видят. Наконец, с развитием отношений пары естественным образом начинают узнавать, уважать и ценить друг друга. Все это не просто оптимистичные разглагольствования, каждое подтверждено исследованием. Поэтому, даже если алгоритмы так и не научатся находить людям идеальные отношения, ту самую единственную — или того самого единственного — можно найти и по-старинке.